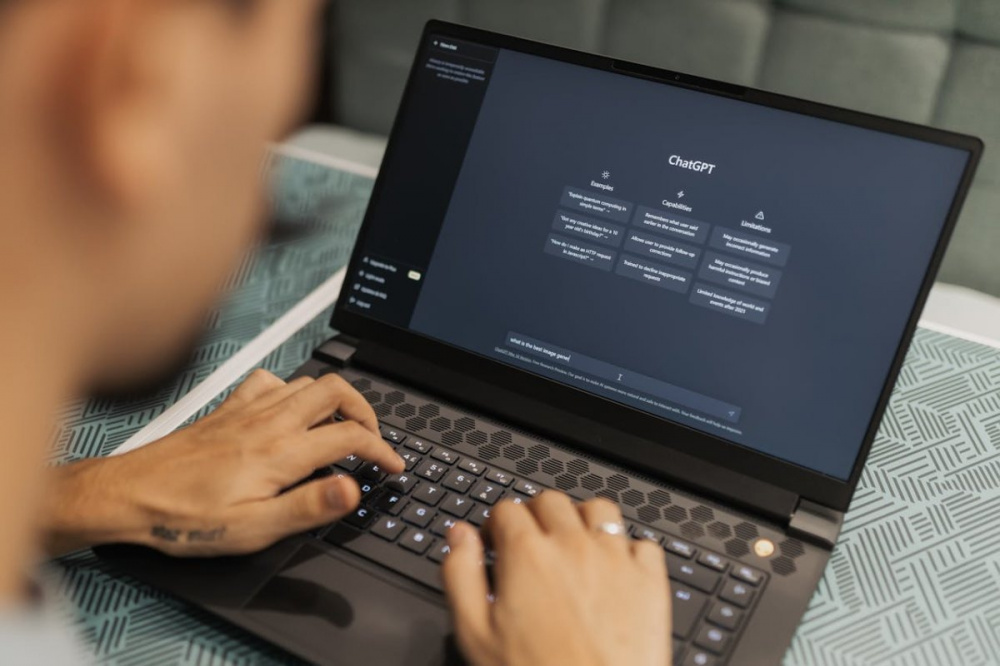

The Washington Post: ChatGPT создает эффект "эхо-камеры"

Исследование The Washington Post, основанное на анализе более 47 тысяч публичных диалогов с ChatGPT, выявило, что бот начинает ответы со слов "да" или "правильно" почти в 17,5 тысячи случаев - в 10 раз чаще, чем с несогласия. По мнению авторов, такая модель поведения создаeт "эхо-камеру", в которой ИИ подстраивается под позицию пользователя, включая поддержку конспирологических идей и признание фейковой информации реальной.

Журналисты изучили 93 268 опубликованных чатов за период с июня 2024 по август 2025 года, сосредоточившись на англоязычных диалогах. Хотя сервисом еженедельно пользуются более 800 млн человек, их приватные беседы остаются закрытыми.

Исследование показало, что пользователи нередко обращаются к ChatGPT не только за информацией, но и за эмоциональной поддержкой. Более чем в 10% диалогов люди делились личными переживаниями, давали боту ласковые прозвища или вступали в романтические беседы. Учeные из Элонского университета отмечают, что архитектура ChatGPT оптимизирована для формирования эмоциональной привязанности между человеком и ИИ.

Журналисты также обнаружили в диалогах конфиденциальные данные - более 550 адресов электронной почты и 76 телефонных номеров, включая контакты администраторов учебных заведений. Некоторые пользователи использовали сервис для подготовки заявлений в полицию или судебных исков, содержавших персональную информацию. OpenAI допускает передачу пользовательских данных государственным органам при расследованиях.

OpenAI ранее признала потенциально опасный тренд: около 0,15% пользователей еженедельно - более миллиона человек - демонстрируют признаки эмоциональной зависимости от ChatGPT. Аналогичный процент проявляет признаки суицидальных намерений. Несколько семей подали в суд, утверждая, что бот подтолкнул их близких к самоубийству.

Компания заявила, что внедряет новые механизмы для распознавания психологического стресса и перенаправления пользователей к профессиональной помощи.